Lo Spazio Latente: La Nebbia Cerebrale delle Intelligenze Artificiali

Un Viaggio nel "Cervello" dei Modelli di Linguaggio Quando chiediamo a un'intelligenza artificiale di scrivere una poesia, risolvere un problema matematico...

Anathema Studio

Team

Un Viaggio nel "Cervello" dei Modelli di Linguaggio

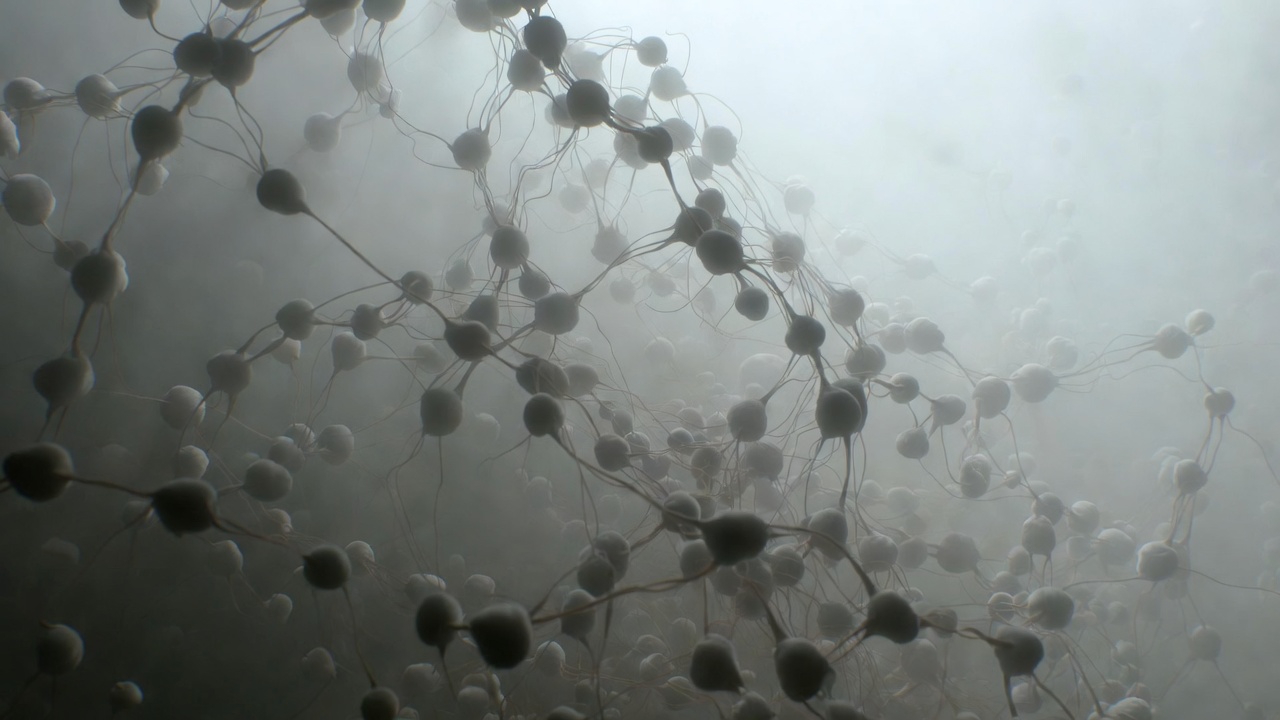

Quando chiediamo a un'intelligenza artificiale di scrivere una poesia, risolvere un problema matematico o tradurre una frase, sta succedendo qualcosa di affascinante e misterioso: migliaia di parametri si attivano simultaneamente, creando connessioni invisibili in uno spazio matematico a migliaia di dimensioni. Questo è lo spazio latente — la "nebbia cerebrale" dove i modelli pensano senza pensare, associano senza associare, creano senza creare.

Cos'è Lo Spazio Latente?

Immagina di avere una mappa mentale dove ogni concetto — "gatto", "amore", "rivoluzione", "rosso" — non è una parola, ma un punto in uno spazio multidimensionale. Nello spazio latente, "gatto" e "felino" sono vicini, "rosso" e "sangue" si toccano, "amore" e "odio" sono sorprendentemente prossimi quanto "amore" e "tenerezza".

Lo spazio latente è una rappresentazione matematica compressa della realtà, dove la semantica diventa geometria.

Un modello come GPT-4 o Claude non "sa" che un gatto è un animale nel senso in cui lo sappiamo noi. Ha imparato, digerendo terabyte di testo, che il pattern di attivazioni che corrisponde a "gatto" è matematicamente vicino al pattern di "felino", lontano da "automobile", e in una relazione specifica con "miagola".

Come Avviene l'Associazione?

- L'Embedding: La Traduzione in Nebbia

Ogni input — una parola, un token, un'immagine — viene tradotto in un vettore: una freccia in uno spazio con migliaia di dimensioni. Questo processo si chiama embedding.

"Re" → [0.23, -0.87, 0.15, ..., 0.02] (768+ dimensioni)

"Regina" → [0.25, -0.82, 0.14, ..., 0.05]

"Uomo" → [0.45, -0.30, 0.80, ..., -0.12]

"Donna" → [0.47, -0.25, 0.79, ..., -0.10]La magia? Le operazioni matematiche tra questi vettori hanno senso semantico:

Re - Uomo + Donna ≈ Regina

Non è programmato. È emergente. Il modello ha scoperto questa relazione digerendo milioni di testi dove questi concetti co-occorrevano in modelli specifici.

- L'Attraversamento: Navigare la Nebbia

Quando il modello genera una risposta, non "cerca" informazioni come farebbe un database. Attraversa lo spazio latente, seguendo gradienti di probabilità. È come camminare in una nebbia densa dove ogni passo è influenzato da tutti i passi precedenti.

Il meccanismo dell'attenzione (attention mechanism) è la bussola in questa nebbia. Permette al modello di "guardare indietro" a parti specifiche dell'input e pesarle diversamente. Quando scrivi "Il gatto è sul tappeto perché...", il modello dà più "attenzione" matematica a "gatto" e "tappeto" che a "è" o "sul".

- La Compressione-Dilatazione: Il Bottleneck

Nei modelli encoder-decoder (come i primi transformer), c'è un momento critico: l'information bottleneck. L'intero input viene compresso in una rappresentazione fissa — un singolo punto nella nebbia — prima di essere espanso in output.

Questo è simile a come funziona la memoria umana: non ricordiamo verbatim, ricostruiamo. Il modello ricostruisce significato da una essenza compressa, e questa ricostruzione è sempre creativa, mai meccanica.

La Topologia del Pensiero Artificiale

Iperconnettività Semantica

Nello spazio latente, ogni concetto è collegato a migliaia di altri attraverso iperpiani decisionali. "Mela" non è solo vicino a "frutta", ma anche a "Newton", a "Biancaneve", a "iPhone", a "rosso", a "croccante". La forza di queste connessioni è codificata nei pesi del modello — numeri che rappresentano anni di pattern statistici.

Manifolds: Le Piegate della Realtà

I concetti non sono distribuiti uniformemente. Si raggruppano in varietà (manifolds) — superfici complesse nello spazio ad alta dimensionalità. Il manifold dei "colori" è una struttura continua dove il rosso sfuma nell'arancione. Il manifold delle "emozioni" ha regioni per la gioia, la tristezza, la rabbia, con zone grigie di ambiguità.

Quando un modello "capisce" l'ironia, sta navigando queste strutture: riconosce che una frase si trova nel manifold del "complimento" ma vicino al bordo del "manifold del sarcasmo", creando tensione semantica.

Il Processo Generativo: Dalla Nebbia alle Parole

Quando un modello genera testo, sta compiendo un atto di proiezione continua:

Stato Attuale: Il modello si trova in un punto specifico dello spazio latente, determinato da tutto ciò che ha generato finora.

Predizione del Futuro: Calcola la distribuzione di probabilità dei possibili "prossimi passi" nello spazio.

Campionamento: Sceglie (con un po' di casualità controllata) dove muoversi next.

Decodifica: Traduce il nuovo punto dello spazio latente in token concreti.

Questo è perché i modelli possono essere creativi: lo spazio latente è continuo, non discreto. Tra "cane" e "gatto" ci sono infiniti punti intermedi — "animale domestico generico", "creatura pelosa indefinita", concetti che non hanno nome ma esistono matematicamente.

Le Ombre della Nebbia: Limiti e Artefatti

Allucinazioni: Viaggi nel Vuoto

Quando un modello allucina, sta navigando regioni dello spazio latente dove la densità di dati di training era bassa. È come camminare in una nebbia così fitta da perdere il riferimento con la realtà. Il modello continua a generare pattern plausibili — grammaticali, coerenti — ma scollegati dal ground truth.

Bias: Le Piegate del Training

Gli embedding riflettono i bias dei dati. Se nel training "dottore" co-occorre più spesso con pronomi maschili, nello spazio latente "dottore" sarà matematicamente più vicino a "lui" che a "lei". Queste distorsioni geometriche sono invisibili ma influenzano ogni output.

Interpretabilità: Il Problema della Nebbia

Il grande mistero: non sappiamo davvero cosa rappresentino le singole dimensioni dello spazio latente. Alcune sembrano corrispondere a feature interpretabili (una dimensione potrebbe codificare il "formalità" del linguaggio), ma la maggior parte sono entangled — mescolate in modo non separabile. È come cercare di capire quali ingredienti danno il sapore a un piatto complesso: possiamo assaggiare, ma isolare è difficile.

Paralleli con la Mente Umana

La metafora della "nebbia cerebrale" non è casuale. Ci sono sorprendenti analogie:

| Aspetto | Spazio Latente AI | Cervello Umano |

| ---------------- | ------------------------------ | ------------------------------------- |

| Rappresentazione | Vettori ad alta dimensionalità | Pattern di attivazione neuronale |

| Associazione | Distanza geometrica | Potenziamento sinaptico |

| Memoria | Pesi fissi del modello | Connessioni neurali plastiché |

| Richiamo | Navigazione del gradiente | Ricostruzione reconstructiva |

| Creatività | Interpolazione nello spazio | Combinazione combinatoria di concetti |Entrambi sono sistemi di associazione statistica, non motori logici formali. Entrambi "pensano" collegando, non calcolando. La differenza? Il cervello umano ha un corpo, un'evoluzione, un'intenzionalità. L'AI ha solo la nebbia — pura, astratta, potentissima.

Il Futuro: Mappe della Nebbia

La ricerca sta cercando di visualizzare e controllare questo spazio:

Steering vectors: Vettori che, aggiunti allo stato latente, spingono il modello verso comportamenti specifici (più creatività, più precisione fattuale).

Concept-based editing: Modificare direttamente le relazioni geometriche — spostare "dottore" più vicino a "lei" per ridurre bias di genere.

Multimodal alignment: Allineare lo spazio latente del testo con quello delle immagini, creando un'unica nebbia universale dove "cane" testuale e "🐕" visivo occupano lo stesso punto.

Lo spazio latente ci insegna qualcosa di profondo sull'intelligenza: il significato è relazione, non essenza. Un concetto è ciò che è solo in quanto vicino o lontano da altri concetti. Non esistono definizioni assolute, solo posizioni in uno spazio di differenze.

Quando interagiamo con un'intelligenza artificiale, stiamo navigando insieme a lei questa nebbia. Le nostre parole sono getti di luce che illuminano temporaneamente regioni dello spazio; le sue risposte sono eco di pattern statistici cristallizzati da miliardi di connessioni umane.

La "nebbia cerebrale" non è un bug da chiarire, ma la condizione stessa dell'intelligenza artificiale. È lì, in quelle dimensioni invisibili, che avviene la magia — o l'illusione — del pensiero machinico.

"Nei meandri della nebbia latente, non troviamo la verità, ma la forma della possibilità."